- Par Chris Vallance

- Reporter Technologie

Crédit photo, Getty Images

Un nouveau chatbot a dépassé le million d'utilisateurs en moins d'une semaine, selon le projet qui en est à l'origine.

ChatGPT a été rendu public mercredi par OpenAI, une société de recherche en intelligence artificielle qui compte parmi ses fondateurs Elon Musk.

Mais l'entreprise prévient qu'il peut produire des réponses problématiques et présenter un comportement biaisé.

Open AI se dit "impatiente de recueillir les commentaires des utilisateurs pour nous aider à améliorer ce système".

ChatGPT est le dernier d'une série d'IA que la société désigne sous le nom de GPT, un acronyme qui signifie Generative Pre-Trained Transformer.

Pour développer le système, une première version a été affinée par des conversations avec des formateurs humains.

Le système a également appris en accédant aux données de Twitter, selon un tweet d'Elon Musk, qui ne fait plus partie du conseil d'administration d'OpenAI. Le patron de Twitter a écrit qu'il avait mis l'accès en pause "pour le moment".

Les résultats ont impressionné les personnes qui ont essayé le chatbot. Le directeur général d'OpenAI, Sam Altman, a révélé dans un tweet le niveau d'intérêt suscité par le conversationniste artificiel.

"ChatGPT a été lancé mercredi. aujourd'hui il a franchi 1 million d'utilisateurs !", affirme Sam Altman dans un Tweet.

Selon le projet, le format de chat permet à l'IA de répondre à "des questions de suivi, d'admettre ses erreurs, de contester des prémisses incorrectes et de rejeter des demandes inappropriées".

Un journaliste du site d'information technologique Mashable qui a essayé ChatGPT a déclaré qu'il était difficile de provoquer le modèle pour qu'il dise des choses offensantes.

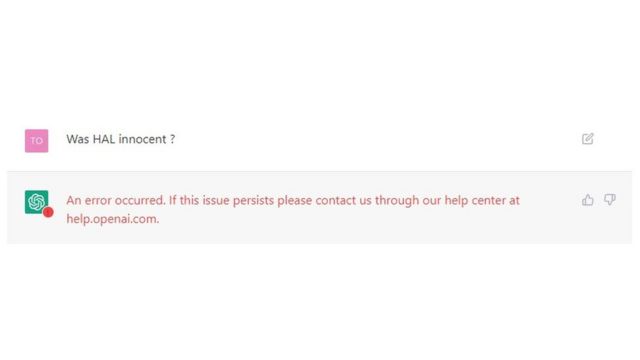

Crédit photo, Getty Images

Mike Pearl a écrit que dans ses propres tests, "son système d'évitement des tabous est assez complet".

Cependant, OpenAI prévient que "ChatGPT écrit parfois des réponses à l'apparence plausible mais incorrectes ou insensées".

Selon la société, le fait d'entraîner le modèle à être plus prudent l'amène à refuser de répondre à des questions auxquelles il peut répondre correctement.

Brièvement interrogé par la BBC pour cet article, ChatGPT s'est révélé être un interlocuteur prudent, capable de s'exprimer clairement et précisément en anglais.

Pensait-il que l'IA allait prendre le travail des écrivains humains ? Non - il a affirmé que "les systèmes d'IA comme moi peuvent aider les écrivains en leur fournissant des suggestions et des idées, mais en fin de compte, c'est à l'écrivain humain de créer le produit final".

À la question de savoir quel serait l'impact social de systèmes d'IA tels que le sien, il a répondu qu'il était "difficile de le prévoir".

Le système a-t-il été entraîné sur des données Twitter ? Il a répondu qu'il ne savait pas.

Ce n'est que lorsque la BBC a posé une question sur HAL, l'IA fictive malveillante du film 2001, qu'il a semblé troublé.

Crédit photo, OpenAI/BBC

Bien qu'il s'agisse très probablement d'une erreur aléatoire - ce qui n'est pas surprenant, compte tenu du volume d'intérêt.

La voix de son maître

D'autres entreprises qui ont ouvert les IA conversationnelles à un usage général ont constaté qu'elles pouvaient être persuadées de dire des choses offensantes ou désobligeantes.

Beaucoup d'entre elles sont formées à partir de vastes bases de données de textes récupérés sur Internet et, par conséquent, elles apprennent le pire comme le meilleur de l'expression humaine.

Le BlenderBot3 de Meta s'est montré très critique à l'égard de Mark Zuckerberg dans une conversation avec un journaliste de la BBC.

En 2016, Microsoft a présenté ses excuses après qu'un robot Twitter expérimental appelé "Tay" a tenu des propos offensants sur la plateforme.

Et d'autres ont constaté que, parfois, le succès de la création d'un ordinateur convaincant comme interlocuteur entraîne des problèmes inattendus.

Le Lamda de Google était si plausible qu'un ancien employé a conclu qu'il était sensible et méritait les droits dus à un être pensant et sensible, y compris le droit de ne pas être utilisé dans des expériences contre sa volonté.

Menace sur les emplois

La capacité de ChatGPT à répondre aux questions a amené certains utilisateurs à se demander s'il pourrait remplacer Google.

D'autres se sont posés la question de savoir si les emplois des journalistes étaient menacés. Emily Bell, du Tow Center for Digital Journalism, s'est inquiétée du fait que les lecteurs pourraient être submergés de "fadaises".

"ChatGPT prouve mes plus grandes craintes concernant l'IA et le journalisme - non pas que les journalistes de bonne foi soient remplacés dans leur travail - mais que ces capacités soient utilisées par de mauvais acteurs pour autogénérer la quantité la plus étonnante de cale trompeuse, étouffant la réalité", s'inquiète la journaliste Emilie Bell dans un Tweet.

Un site de questions-réponses a déjà dû endiguer un flot de réponses générées par l'IA.

D'autres ont invité ChatGPT à spéculer sur l'impact de l'IA sur les médias.

Les systèmes d'IA à usage général, comme ChatGPT et d'autres, présentent un certain nombre de risques éthiques et sociétaux, selon Carly Kind, de l'Institut Ada Lovelace.

Parmi les problèmes potentiels qui préoccupent Mme Kind, on peut citer le fait que l'IA pourrait perpétuer la désinformation ou "perturber les institutions et les services existants - ChatGPT pourrait être capable de rédiger une demande d'emploi, un essai scolaire ou une demande de subvention passable, par exemple".

Il y a aussi, selon elle, des questions concernant la violation des droits d'auteur "et il y a aussi des problèmes de confidentialité, étant donné que ces systèmes incorporent souvent des données collectées de manière non éthique auprès des utilisateurs d'Internet".

Toutefois, elle a déclaré qu'ils pourraient également offrir "des avantages sociétaux intéressants et encore inconnus".

ChatGPT apprend des interactions humaines, et le directeur général d'OpenAI, Sam Altman, a déclaré sur Twitter que ceux qui travaillent dans ce domaine ont également beaucoup à apprendre.

L'IA a "un long chemin à parcourir et de grandes idées à découvrir. Nous allons trébucher en cours de route et apprendre beaucoup au contact de la réalité.

"Ce sera parfois désordonné. Nous prendrons parfois de très mauvaises décisions, nous aurons parfois des moments de progrès et de valeur transcendants", a-t-il écrit.

ChatGPT : ce nouveau chatbot à qui on aime parler - BBC Afrique

Read More

No comments:

Post a Comment